Je to silná káva. Takéto čosi nás v autoškole neučia a úvahy o obetovaní ľudského života (alebo viacerých) pri minimalizácii ďalších strát, sú tak trochu tabu.

Ide o etický problém, ale zároveň o praktickú otázku. V prípade autonómnych áut by sa malo toto rozhodovanie stať integrálnou súčasťou riadiaceho systému.

Pripadá vám neetické uvažovať nad možnosťou, že by autonómne auto mohlo obetovať vodiča, alebo celú posádku v prospech záchrany chodcov, alebo iných účastníkov premávky?

Obeť, alebo hrdina?

Predstavte si situáciu, že autu z nejakého dôvodu zlyhajú brzdy a rúti sa na nástupný ostrovček plný ľudí, čakajúcich na električku. Pri náraze môže niekoľko z nich zahynúť, no vodičovi sa vďaka airbagom pri zrážke s „mäkkým“ cieľom pravdepodobne nič nestane. Druhou možnosťou je nasmerovanie auta do betónovej bariéry na opačnej strane cesty, no hrozí, že vodič zahynie, alebo utrpí vážne zranenia.

Živý vodič nebude vždy konať ako hrdina. Šok, pud sebazáchovy a ďalšie faktory môžu spôsobiť, že vrazí do ľudí. Po nehode prídu na rad experti a iní „generáli po bitke“, ktorí budú špekulovať, či a ako sa dalo tragédii zabrániť.

Superpočítač v autonómnom aute nemá problém s rozhodovaním, pokiaľ dokáže nájsť adekvátne riešenie vo svojej databáze, alebo má algoritmus, ktorý s riešením danej situácie počíta. Čierneho Petra v tomto prípade držia programátori, ktorí môžu byť v budúcnosti hnaní aj na zodpovednosť. To ich vedie k obavám a k zdravej opatrnosti.

Moral Machine ako škola etiky

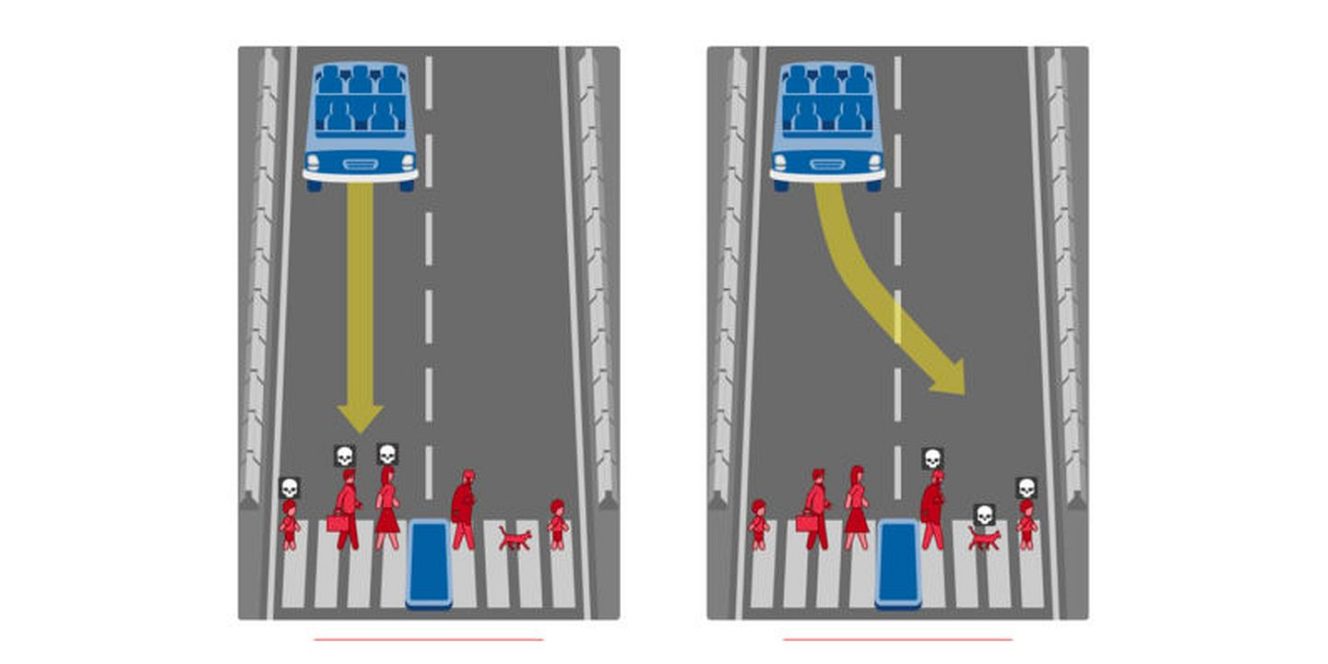

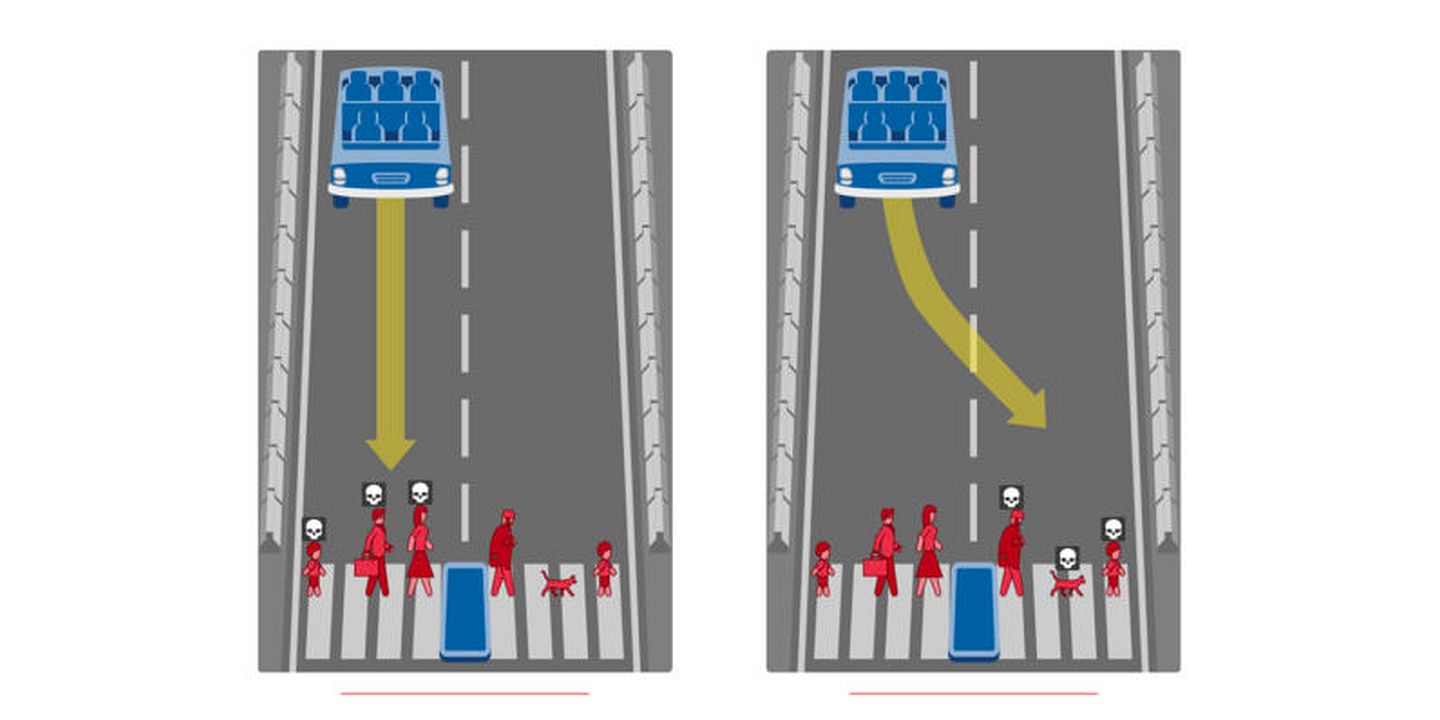

Originálnou cestou sa rozhodli vydať vedci z MIT. Vytvorili stránku Moral Machine, ktorá formou akejsi hry modeluje rôzne dopravné kolízie a hľadá riešenia etických problémov, koho by bolo „výhodnejšie“ v danej situácii obetovať.

Je cennejší život mladého človeka, starca, alebo dieťaťa? Je život ženy a muža rovnocenný? Čo ak sa medzi potenciálnymi obeťami nachádzajú zločinci? Naraziť radšej do jedného chodca, ako ohroziť dvojčlennú posádku? Ako to vychýli váhy rozhodovania palubného počítača?

Stránka Moral Machine tak vlastne simuluje riešenie klasického „električkového problému“ v množstve nových variácií.

V električkovom probléme išlo o riešenie situácie, keď sa po trati rúti električka s pokazenými brzdami a na koľajniciach je uviaznutých päť ľudí, ktorí pri zrážke pravdepodobne zahynú.

Môžete včas dobehnúť k výhybke a električku odkloniť na vedľajšiu koľaj, kde sa ale tiež nachádza jeden človek.

Ak neurobíte nič, päť ľudí zahynie z „objektívnych príčin“ – kvôli technickej poruche električky. Ak prehodíte výhybku, zomrie síce len jeden človek, ale vy jeho smrť spôsobíte vlastným pričinením. Zdanlivo jednoduchá rovnica nemá ľahké riešenie z morálneho a etického hľadiska.

K 100% bezpečnosti sa môžeme priblížiť, no nedá sa dosiahnuť

Je isté, že autonómne autá budú nakoniec jazdiť bezpečnejšie, ako dnešné vozidlá so živým vodičom za volantom. Rovnako je však isté, že nikdy sa na 100% nebude dať zabrániť prípadnej nehode. V hre je nekonečné množstvo premenných, ktoré generujú nekonečné množstvo scenárov.

Aby sa fatálne situácie minimalizovali, je preto nevyhnutné vytvárať čo najrozsiahlejšie databázy situácií a čo najlepšie algoritmy. V neposlednom rade bude potrebné umelú inteligenciu aj školiť, a to aj za pochodu, či v tomto prípade „za jazdy“. Rôzne programátorské postupy, vrátane zdieľania poznatkov a dát ostatných autonómnych áut v cloude, pomôžu vytvoriť maximálne bezpečné vozidlá.